입력 2026.02.20 09:34

서강대학교(총장 심종혁) 컴퓨터공학과 최준석 교수 연구팀(이민영 박사과정, 박예지 석박통합과정, 황동준 박사과정, 김예진 석사과정)은 다중 이미지 입력 환경에서 대규모 비전-언어 모델 (Large Vision-Language Models, LVLMs)에서의 구분 토큰의 역할을 분석하고, 이를 통해 성능을 향상시키는 효과적인 기법을 제안하여 국제 저명 학술대회 International Conference on Learning Representations (ICLR) 2026에 논문이 채택되었다. ICLR은 인공지능 및 머신러닝 분야에서 세계적으로 권위 있는 국제 학술대회로, 오는 4월 23일부터 27일까지 브라질 리우 데 자네이루에서 개최될 예정이다.

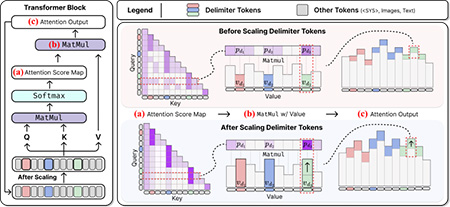

LVLM은 단일 이미지 기반 과제에서는 우수한 성능을 보인다. 그러나 여러 이미지를 동시에 입력받는 경우 이미지 간 정보가 혼합되는 cross-image information leakage 문제로 인해 추론 성능이 크게 저하되는 한계가 존재한다. 기존 모델들은 이미지 구분을 위해 delimiter 토큰을 사용하고 있으나, 본 연구팀의 분석 결과 이러한 토큰들이 실제로는 이미지 간 정보 누수를 효과적으로 차단하지 못함을 확인하였다.

이에 본 연구팀은 delimiter 토큰의 hidden state를 스케일링하는 간단하면서도 효과적인 기법을 제안하였다. 해당 방법은 이미지 내부 토큰 간 상호작용(intra-image interaction)을 강화하는 동시에, 서로 다른 이미지 간의 불필요한 상호작용을 억제함으로써 모델이 이미지별 정보를 보다 명확히 구분하고 정확한 다중 이미지 추론을 수행할 수 있도록 한다.

본 연구는 LVLM에서 상대적으로 간과되어 온 delimiter 토큰의 역할을 재조명하고, 모델 구조 변경이나 추가 학습 없이도 멀티 입력 추론 성능을 안정적으로 향상할 수 있는 실용적인 해법을 제시했다는 점에서 의의가 있다. 향후 멀티 이미지·멀티 문서 기반 AI 시스템의 신뢰성과 정확도를 높이는 핵심 기술로 활용될 것으로 기대된다.

▶논문 제목: Enhancing Multi-Image Understanding through Delimiter Token Scaling

▶저자: 이민영(제 1저자, 서강대), 박예지(제 2저자, 서강대), 황동준(제 3저자, 서강대), 김예진(제4저자, 서강대/카이스트), 오성준(제 5저자, 카이스트/University of Tübingen), 최준석(교신저자, 서강대)

▶논문 링크: https://arxiv.org/abs/2602.01984

▶코드 링크: https://github.com/MYMY-young/DelimScaling