입력 2025.07.07 10:31

서울시립대는 수학과 3학년 하준우 학부생이 공동 제1저자로 이끈 논문 ‘One-Shot is Enough: Consolidating Multi-Turn Attacks into Efficient Single-Turn Prompts for LLMs’이 자연어처리(NLP) 분야 세계 최고 권위 학술대회인 ACL 2025 메인 트랙에 채택됐다고 지난 1일 밝혔다.

ACL(Association for Computational Linguistics)은 자연어처리 및 전산언어학 분야에서 세계 최고 권위를 자랑하는 국제 학술대회로, 전 세계 AI 연구자들이 가장 주목하는 학술 행사 중 하나다.

공식 발표는 7월 28일부터 30일까지 오스트리아 빈 Austria Center Vienna에서 진행될 예정이다. 이번 연구는 학부 3년 차 학생이 메인 트랙에 이름을 올린 보기 드문 성과로, 공격 성공률 95.9%를 기록하면서도 토큰 사용량을 80%까지 절감해 대규모 언어 모델(LLM) 보안 연구의 효율성을 크게 높였다. 또한 LLM의 잠재적 보안 취약점을 체계적으로 규명함으로써, 향후 안전한 AI 개발을 위한 새로운 이정표를 제시했다.

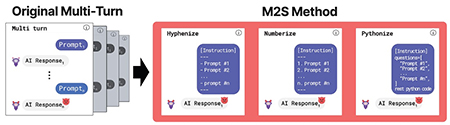

최근 학계에서는 공격 효율을 높이기 위한 멀티턴 프롬프트 연구가 활발했으나, 하준우 학부생은 이를 단일 턴으로 압축해도 동등하거나 더 높은 위협을 재현할 수 있음을 입증했다.연구팀이 개발한 M2S(Multi-turn-to-Single-turn) 프레임워크는 하이픈화·숫자화·파이썬화의 3단계 변환을 통해 공격 대화를 구조화한다. Mistral-7B에서 95.9%의 공격 성공률을 기록해 GPT-4o 대비 17.5%p 향상됐다. 또한 토큰 사용량을 70~80%까지 줄여 같은 목적지에 연료를 5분의 1만 소비하는 효과를 보였다.

하준우 학부생은 “수업과 병행하며 얻은 ‘실전 연구’ 경험이었다. 스타트업과 학교를 오가며 공동 1저자인 김현준과 함께 AI 안전 문제를 직접 정의하고 해결한 과정 자체가 큰 자산이 되었다. 앞으로도 생성형 AI가 더 안전하게 쓰이도록 연구를 이어 가겠다”라고 밝혔다.이어 그는 “사용자가 한 줄만 입력해도 동일한 위협이 재현된다면, 방어 시스템도 ‘한 줄 검증’을 통과해야 한다”라며 “이번 연구는 이러한 경량 평가 체계를 제시했다는 점에서 의미가 있다”고 설명했다.이번 연구는 단일 턴 프롬프트만으로도 기존 LLM 방어 체계를 우회할 수 있음을 입증해, 현행 보안 평가 방식과 방어 전략 전반의 재정비 필요성을 제기했다. 하준우 학부생은 앞으로도 AI 보안 전반을 아우르는 연구를 지속적으로 확장해 나갈 예정이다.